使用教程

选择工具,按步骤快速配置

[{token}]

[{copyTip==='token'?'已复制 ✓':'点击复制'}]

[{baseUrl}]

[{copyTip==='base'?'已复制 ✓':'点击复制'}]

智谱 GLM-5 系列:请使用 glm-5.1

本教程部分内容编写较早,文中或截图里若仍出现 glm-5,视为过时写法。连接本站中转时,请在各工具配置里手动改为与智谱官方一致的 glm-5.1,勿照抄旧名。

1下载安装

GitHub前往 GitHub Releases 下载对应平台版本:

- Windows —

.msi安装包 - macOS —

.zip或brew install --cask cc-switch - Linux —

.deb / .rpm / .AppImage

2获取 API 信息

- 前往 秘钥激活页面 输入秘钥并激活

- 激活成功后复制 API Key(sk- 开头)和 Base URL

3配置 API

打开 CC Switch → 点击「Add Provider」

选择 Custom(自定义)配置类型

填写 API 信息(参考下图红框标注)

您的 API 密钥 (sk-...)http://model.imfan.topAnthropic Messages (原生)[{modelName}]

点击「保存」→「Enable」启用

CC Switch 会自动写入配置文件。重启终端后执行 claude 即可生效。

系统托盘快速切换

CC Switch 常驻系统托盘,右键点击即可在多个 API 提供商之间一键切换,非常方便。

常见问题

一准备工作

1. 安装 Node.js(必需,18+)

访问 Node.js 官网 下载 LTS 版安装,勾选 Add to PATH。

node -v npm -v

2. 安装 Git(可选)

git --version

二安装 Claude Code CLI

可选:切换国内 npm 镜像

npm config set registry https://registry.npmmirror.com

全局安装

npm install -g @anthropic-ai/claude-code

验证安装

claude --version

三获取 API Key

- 前往 秘钥激活页面 输入秘钥并激活

- 激活成功后复制 API Key(sk- 开头)和 Base URL

四配置

Step 1:编辑 settings.json

Windows: C:\Users\您的用户名\.claude\settings.json

MacOS/Linux: ~/.claude/settings.json

{

"env": {

"ANTHROPIC_BASE_URL": "http://model.imfan.top",

"ANTHROPIC_AUTH_TOKEN": "您的API密钥",

"API_TIMEOUT_MS": "3000000",

"CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC": 1,

"ANTHROPIC_MODEL": "MiniMax-M2.5" 或者 "glm-5.1",

"ANTHROPIC_SMALL_FAST_MODEL": "MiniMax-M2.5" 或者 "glm-5.1",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "MiniMax-M2.5" 或者 "glm-5.1",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "MiniMax-M2.5" 或者 "glm-5.1",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "MiniMax-M2.5" 或者 "glm-5.1"

}

}Step 2:编辑 .claude.json

Windows: C:\Users\您的用户名\.claude.json | Mac/Linux: ~/.claude.json

{"hasCompletedOnboarding": true}⚠️ 注意:如果你的 .claude.json 中已有 "primaryApiKey" 字段,请将其值修改为你在本站获取的 API 密钥,否则会导致请求认证失败。

五使用

启动对话

claude

查看帮助

claude --help

常见问题

1前置要求

- Node.js ≥ 22, npm ≥ 10

- 操作系统 Linux / macOS / Windows

- 创建令牌时选择 Codex 分组

2安装 Codex CLI

安装 Git 和 Node.js LTS 后:

npm install -g @openai/codex codex --version

brew install node@22 sudo npm install -g @openai/codex codex --version

# Ubuntu/Debian curl -fsSL https://deb.nodesource.com/setup_22.x | sudo -E bash - sudo apt-get install -y nodejs sudo npm install -g @openai/codex codex --version

3配置

在 ~/.codex/(Windows: %USERPROFILE%\.codex\)下创建配置文件:

auth.json

{

"auth_mode": "apikey",

"OPENAI_API_KEY": "您的Codex API密钥"

}config.toml

model_provider = "custom" model = "MiniMax-M2.5" model_reasoning_effort = "medium" disable_response_storage = true [model_providers.custom] name = "custom" base_url = "http://model.imfan.top/v1" wire_api = "responses" requires_openai_auth = true

| 参数 | 说明 | 值 |

|---|---|---|

model | 模型名称 | [{modelName}] |

model_reasoning_effort | 思考程度 | high / medium / low |

base_url | API 端点 | http://model.imfan.top/v1 |

wire_api | API 协议 | responses |

4启动使用

# 进入项目目录 cd /path/to/your/project # 启动交互式会话 codex # 或指定模型单次任务 codex --model MiniMax-M2.5 "用Python写一个快速排序"

VSCode 集成

在 VSCode 扩展商店搜索 codex,安装官方插件后侧边栏即可使用,自动读取 ~/.codex 配置。

常见问题

1安装

推荐下载 OpenCode 桌面客户端,图形界面更直观易用:

前往下载 OpenCode 客户端终端安装方式(高级用户)

# macOS / Linux curl -fsSL https://opencode.ai/install | bash # 或使用 Go 安装 go install github.com/opencode-ai/opencode@latest

opencode --version

2配置(面板方式,推荐)

启动 OpenCode 后,通过面板添加自定义提供商,按以下步骤操作:

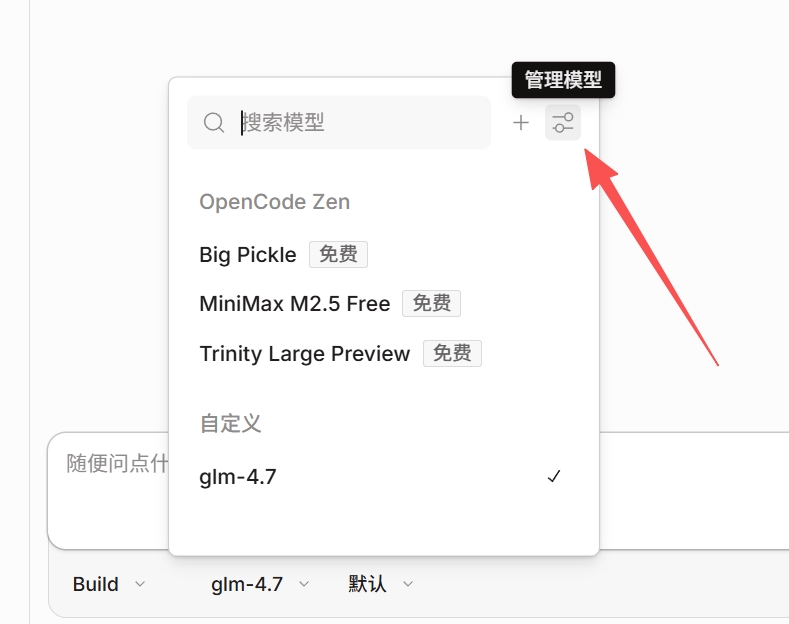

打开模型选择器 → 点击「管理模型」

在底部状态栏点击模型名称打开模型选择器,然后点击右上角的 齿轮图标(管理模型)。

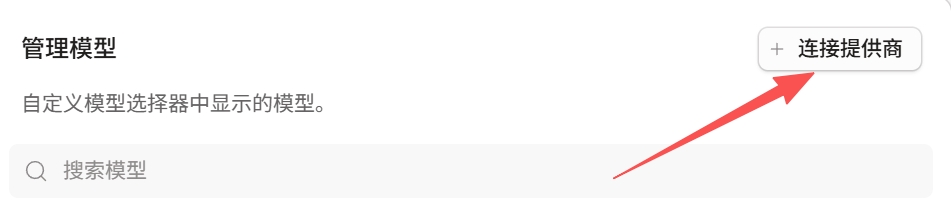

点击「+ 连接提供商」

进入管理模型页面后,点击右上角的 + 连接提供商 按钮。

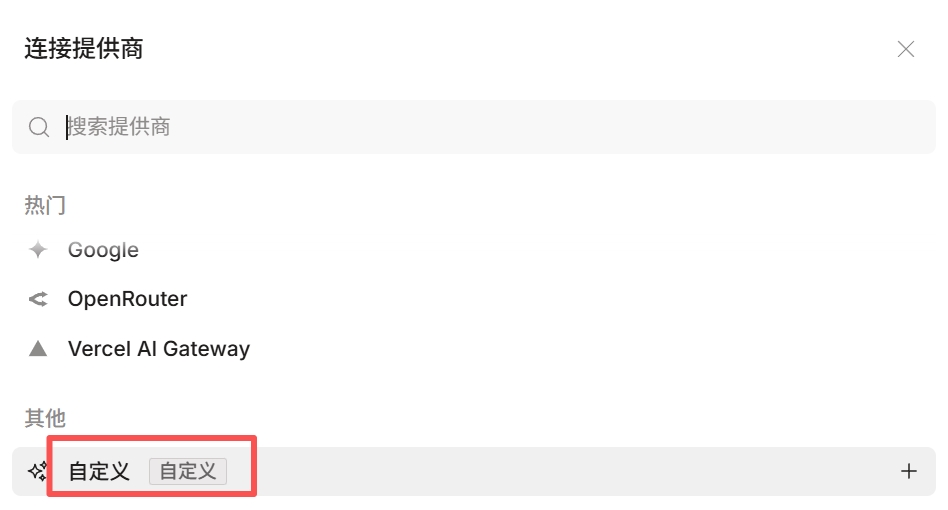

选择「自定义」

在提供商列表最下方的 其他 分类中,点击 自定义。

填写提供商信息

[{/^glm/i.test(modelName)?'glm':'minimax'}]自定义即可[{/^glm/i.test(modelName)?'glm':'minimax'}]随便写,自己能看明白就行!http://model.imfan.top/v1必须加 /v1 !您的 API 密钥 (sk-...)[{modelName}]左右两栏填一样的模型名

保存后选择模型

保存配置后,回到模型选择器,在「自定义」分类下找到刚添加的模型,点击选中即可开始使用。

3配置(JSON 文件 / CLI 方式)

OpenCode 还支持通过 JSON 配置文件或命令行进行配置,详细用法请参考官方文档:

查看 OpenCode 官方文档/v1 结尾。

4使用

# 进入项目目录并启动 cd /path/to/your/project opencode

1下载安装

前往 Cherry Studio 官网 或 GitHub Releases 下载:

- Windows — .exe 安装包

- macOS — .dmg 安装包

- Linux — .AppImage / .deb

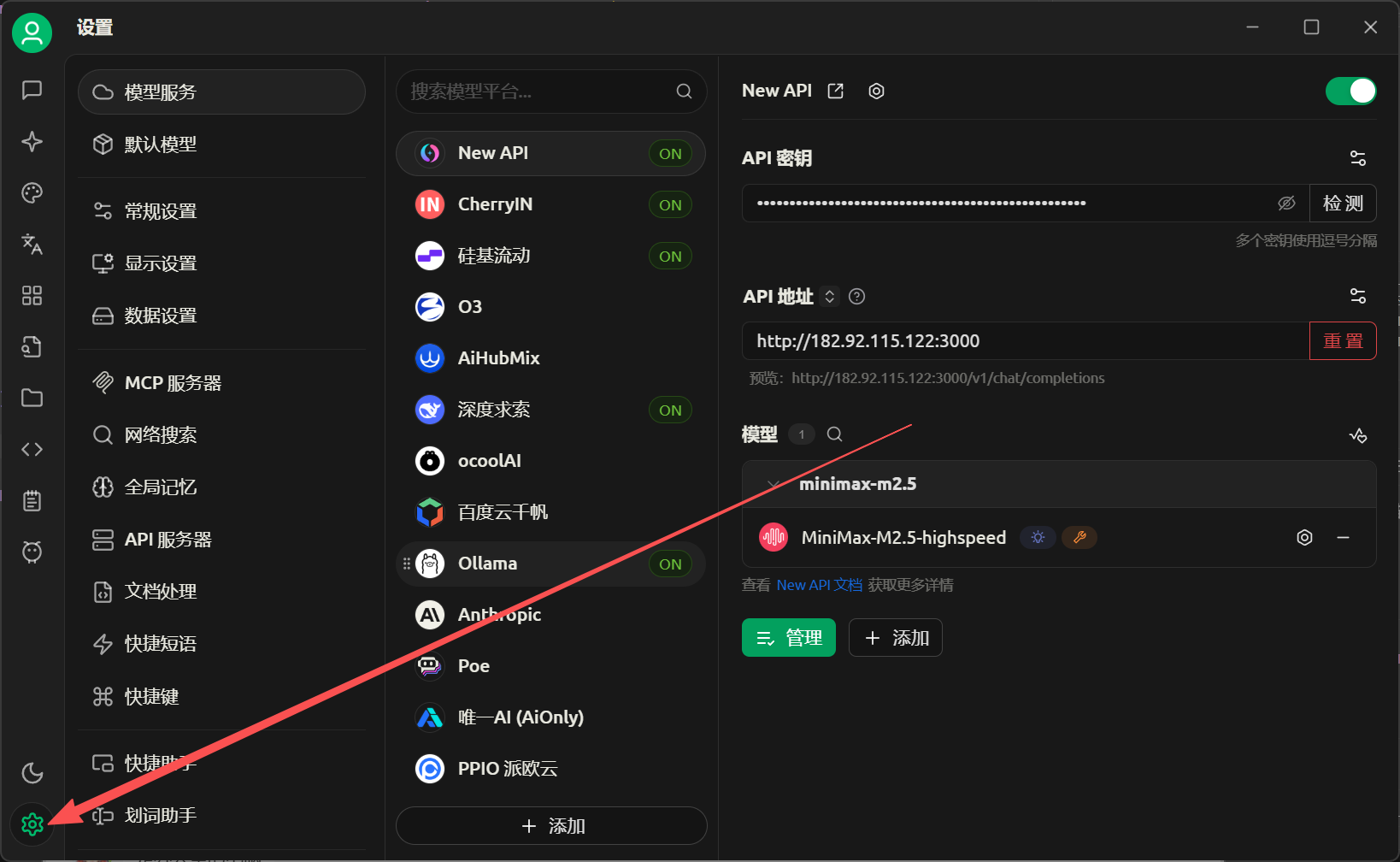

2打开设置

点击左下角的 齿轮图标,进入设置页面,然后选择左侧的 「模型服务」。

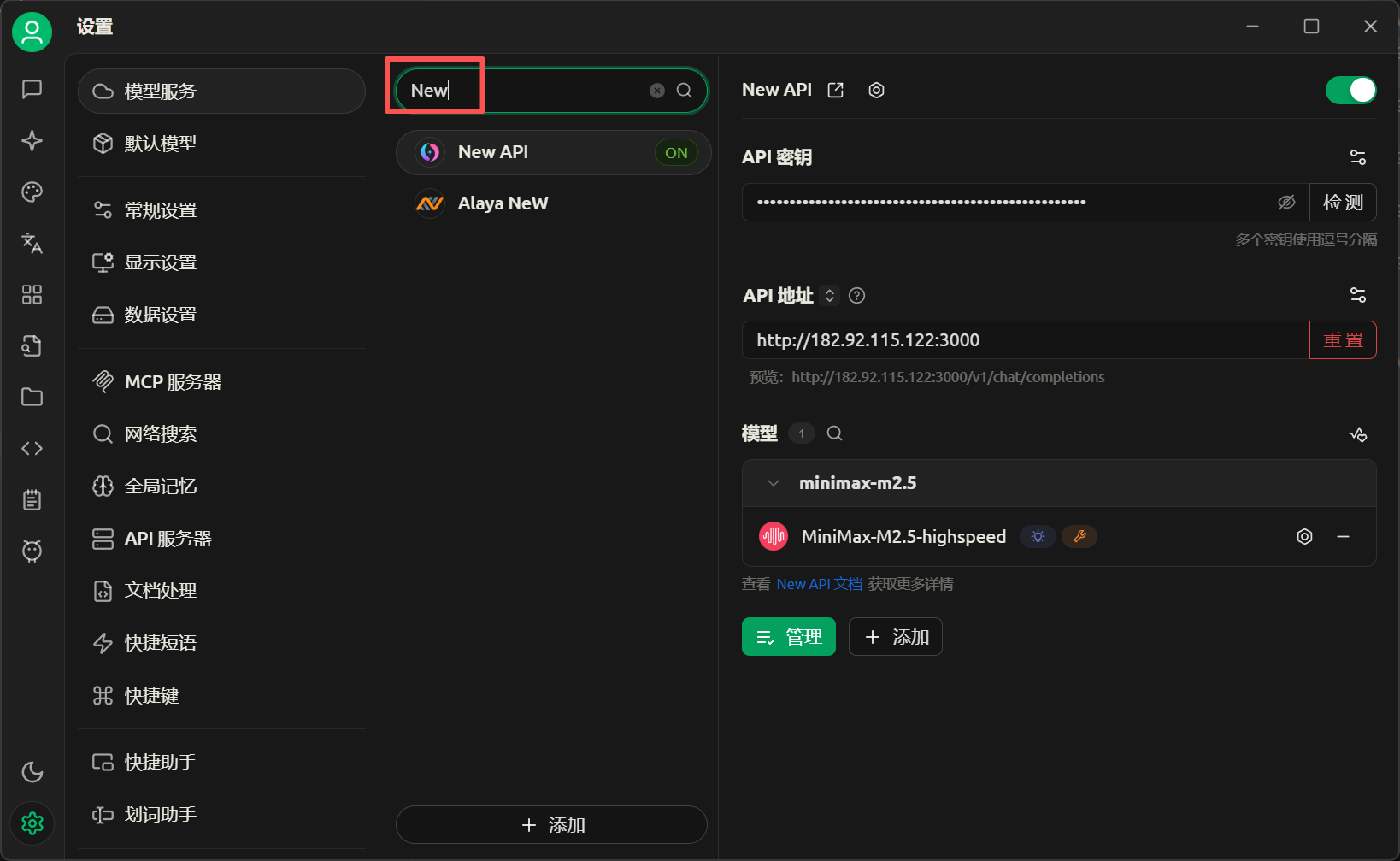

3找到 New API 服务商

在模型服务商列表上方的搜索框中输入 「New」,找到并点击 「New API」。

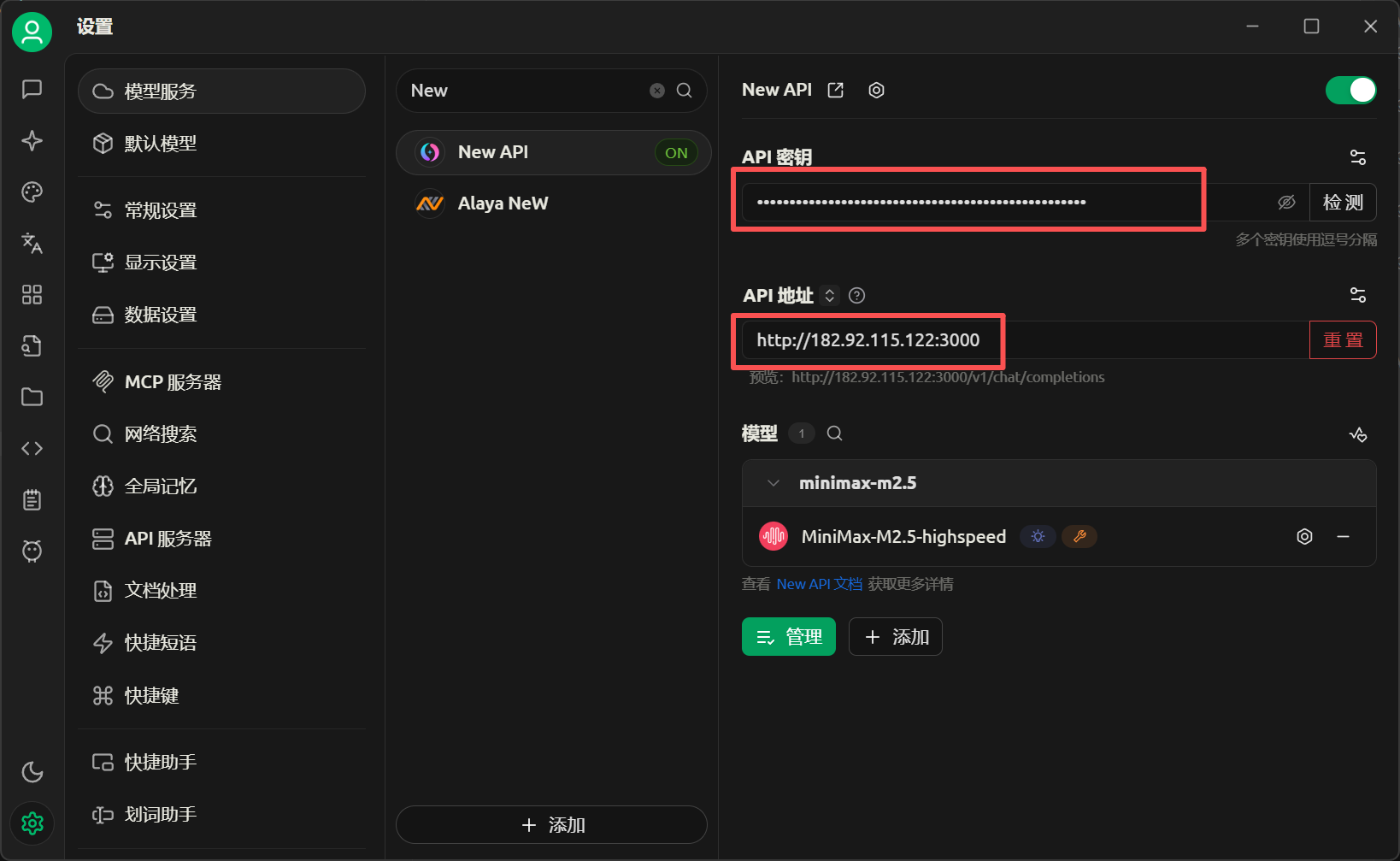

4填写 API 密钥和地址

将激活页面中获取的 API 密钥 和 API 地址 分别填入对应的输入框:

激活页面复制的密钥 (sk-...)http://model.imfan.top

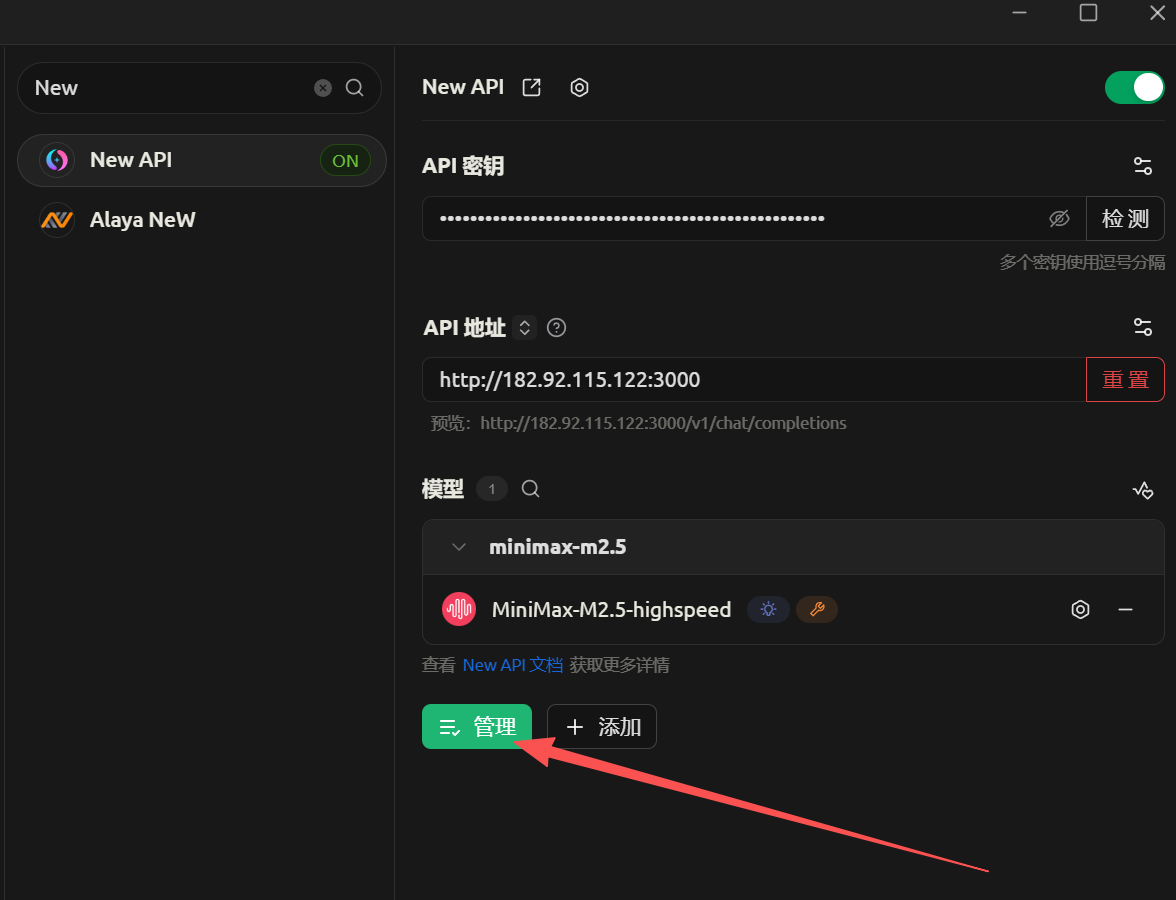

5管理模型

向下滚动到模型区域,点击 「管理」 按钮,打开模型管理面板。

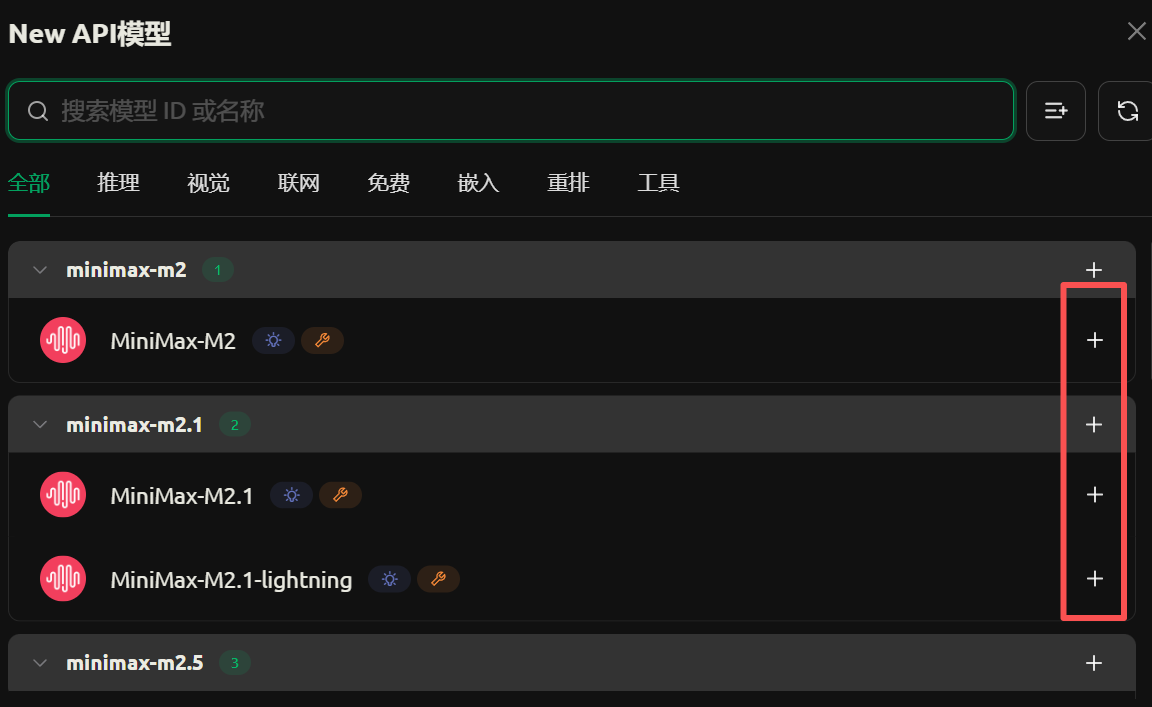

6选择模型

在模型列表中,找到您想使用的模型,点击右侧的 「+」 按钮添加。可以使用顶部搜索框或分类标签快速筛选。

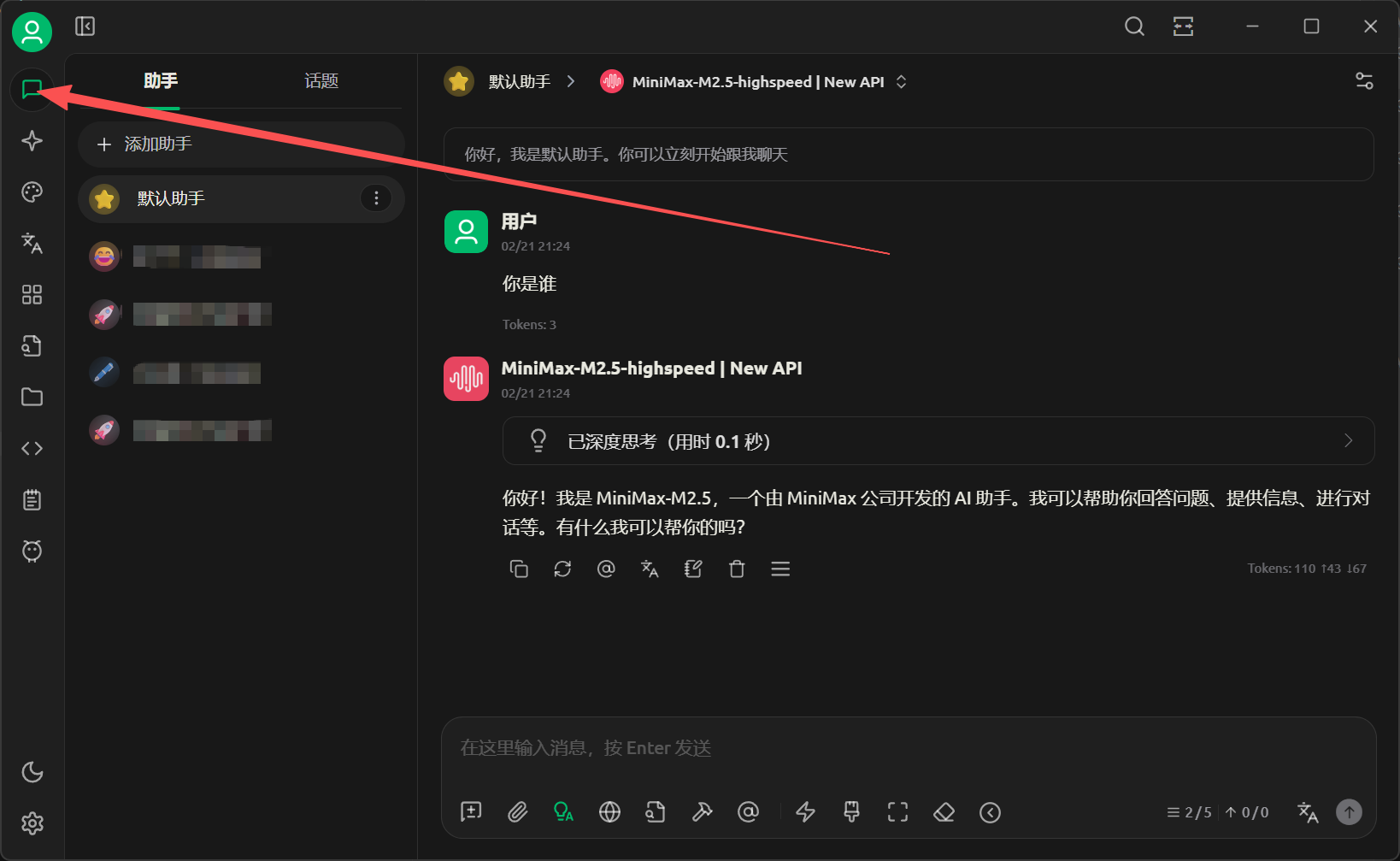

7开始对话

返回主界面,点击左侧 「助手」 图标,选择刚才添加的模型即可开始 AI 对话。

1安装插件

- 打开 VS Code

- 扩展商店搜索

Kilo Code - 点击安装

2配置 API

打开 Kilo Code 设置

安装后侧边栏出现 Kilo Code 图标,点击打开 → 设置

选择 API Provider → OpenAI Compatible

http://model.imfan.top/v1您的 API 密钥选择或输入模型名称开始使用

配置完成后即可在编辑器中选中代码进行提问、生成、重构等操作。

models.json 自定义模型与接口。智谱官方文档以 GLM Coding Plan 为例;本站为 OpenAI 兼容 中转时,将 url 设为本页 Base URL + /v1,id 填写本站支持的模型名即可(智谱 GLM 主模型请用 glm-5.1,勿沿用旧教程中的 glm-5)。1安装与登录

- 访问 CodeBuddy 使用说明(智谱开放文档),按其中「安装 CodeBuddy」指引下载并安装对应系统版本。

- 安装完成后启动应用,按提示完成账号登录。

2配置文件位置

models.json 用于自定义模型列表与下拉展示。建议在用户级配置(对所有项目生效):

- macOS / Linux:

~/.codebuddy/models.json - Windows:

C:\Users\你的用户名\.codebuddy\models.json

若目录不存在,可手动创建 .codebuddy 文件夹后再新建 models.json。

3本站 OpenAI 兼容配置示例

将下方 JSON 保存为 models.json。apiKey 请填本页上方复制的 API Key;url 须为完整接口根路径(与 Base URL 一致并包含 /v1)。id 须与中转支持的模型 ID 完全一致(区分大小写)。

{

"models": [

{

"id": "MiniMax-M2.5",

"name": "MiniMax-M2.5",

"vendor": "随便填",

"apiKey": "您的 API 密钥",

"url": "http://model.imfan.top/v1",

"supportsToolCall": true,

"supportsReasoning": true

}

]

}apiKey 填实际密钥字符串,不要写环境变量名;勿将含密钥的文件提交到 Git 或分享给他人。

4字段说明(与官方一致)

以下与 智谱 CodeBuddy 文档 中的 LanguageModel 字段含义一致;本站仅需按需增删 models 数组中的对象即可。

| 字段 | 必填 | 说明 |

|---|---|---|

id | 是 | 模型唯一标识,对话里选择的模型 ID |

name | 否 | 界面显示名称 |

vendor | 否 | 供应商标识,便于区分 |

apiKey | 否 | API 密钥(明文,非变量名) |

url | 否 | API 端点完整路径(OpenAI 兼容一般为 …/v1) |

maxInputTokens | 否 | 最大输入 token |

maxOutputTokens | 否 | 最大输出 token |

supportsToolCall | 否 | 是否支持工具调用 |

supportsImages | 否 | 是否支持图片输入 |

supportsReasoning | 否 | 是否支持推理模式 |

可选顶层字段 availableModels(字符串数组):仅列出要在下拉里展示的模型 id;不配置或为空则展示全部已定义模型。

5回到 CodeBuddy 使用

保存 models.json 后重启 CodeBuddy(若已打开),在对话或模型选择器中选刚配置的 id(如 [{modelName}])即可开始对话。

参考:智谱 GLM 示例(Coding Plan)

若你同时使用官方 GLM Coding Plan,官方示例中 url 为智谱专用地址、id 为 glm-5.1 等,与下方结构相同,仅 endpoint 与模型名不同:

{

"models": [

{

"id": "glm-5.1",

"name": "MyModel",

"vendor": "zhipu",

"apiKey": "Your-API-Key",

"url": "https://open.bigmodel.cn/api/coding/paas/v4",

"supportsToolCall": true,

"supportsReasoning": true

}

]

}常见问题

1安装 OpenClaw

Docker、安装脚本、npm/pnpm、从源码等具体步骤与命令,请以 OpenClaw 官方文档为准,避免与本站教程不同步。

https://docs.openclaw.ai/zh-CN/install2配置模型(推荐用 ocs 一键配置)

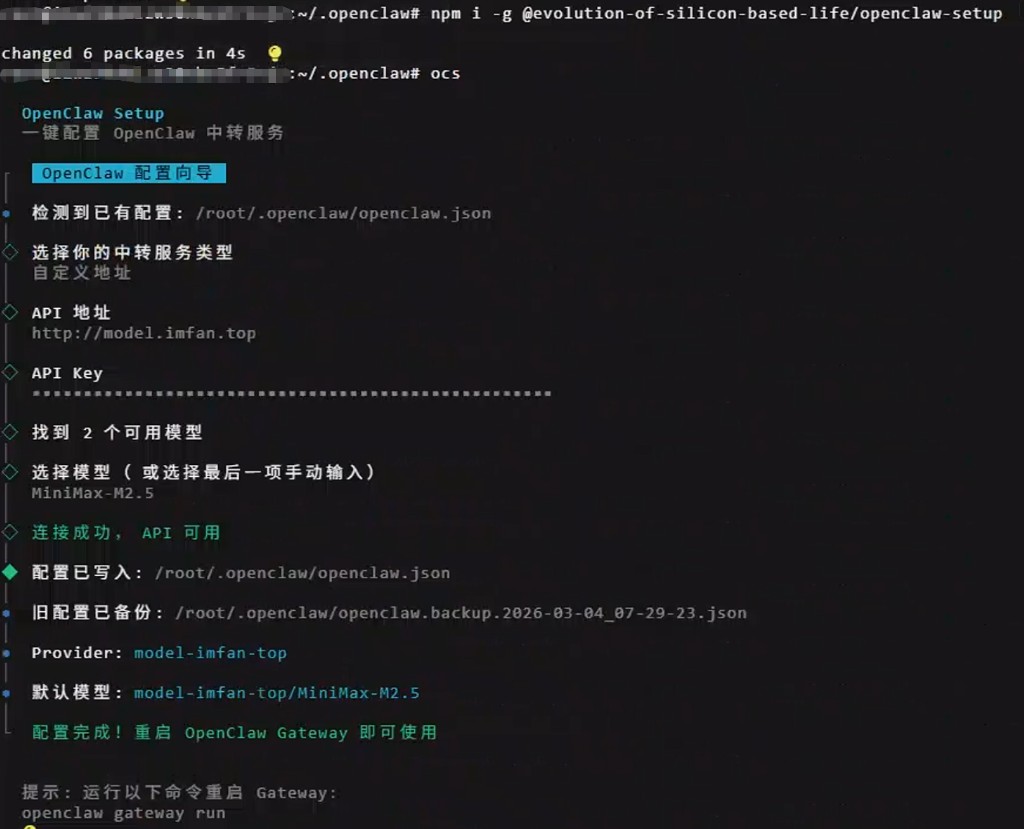

使用 ocs(OpenClaw Setup)按向导填写 API 地址、API Key 并选择模型,配置会自动写入 ~/.openclaw/openclaw.json,无需手改 JSON。

在终端运行 ocs 即可进入 OpenClaw 配置向导,按提示选择「自定义地址」、填写本站的 API 地址与秘钥、选择模型即可完成配置。配置完成后按提示重启 Gateway。

1. 全局安装 openclaw-setup

npm i -g @evolution-of-silicon-based-life/openclaw-setup

安装后使用短命令 ocs 启动交互式向导;还可使用 ocs help、ocs list、ocs test、ocs --web。

2. 复制本站 API 信息与激活秘钥

执行 ocs 前,请在本页上方先复制好 Base URL 和 API Key,向导提示时直接粘贴即可。若 ocs 提示输入「授权码」,请填写你在本站激活时使用的「激活秘钥」(即前往「激活页面」输入的那串秘钥)。

3. 运行 ocs 按向导配置

ocs

在终端输入 ocs 回车。若出现「授权码」提示,把本站的激活秘钥填进去即可;然后按向导选择「自定义地址」、输入 API 地址(如 http://model.imfan.top)、粘贴 API Key、选择模型。配置成功后按提示执行 openclaw gateway run 重启 Gateway。

运行 ocs 后的配置向导示意:选择自定义地址、填写 API 与密钥、选择模型,配置完成后重启 Gateway 即可使用。

可选:一行命令非交互配置

ocs -u http://model.imfan.top/ -k 您的API密钥 -m [{ocsModel}]若已准备好 API 地址、密钥和模型名,可直接用上述命令一次性写入配置,无需交互。

3启动与验证

Docker 方式

# 重启 Gateway docker restart openclaw-openclaw-gateway-1 # 查看日志确认模型加载成功 docker logs openclaw-openclaw-gateway-1 2>&1 | grep "agent model"

CLI 方式

openclaw gateway restart openclaw models list

成功输出示例:agent model: [{ocm==='glm5'?'zai/glm-5.1':'openai/'+modelName}](若日志仍为旧名 glm-5,以配置中的 glm-5.1 为准)

4MiniMax 完整配置示例

以下是使用 MiniMax 中转配置的三个关键文件的完整示例,点击展开查看。

路径:~/.openclaw/openclaw.json

{

"models": {

"mode": "merge",

"providers": {

"minimax-cn": {

"baseUrl": "http://model.imfan.top/v1",

"apiKey": "sk-your-api-key",

"api": "openai-responses",

"models": [

{

"id": "MiniMax-M2.5",

"name": "MiniMax M2.5",

"reasoning": true,

"input": ["text"],

"cost": {

"input": 0.3,

"output": 1.2,

"cacheRead": 0.03,

"cacheWrite": 0.12

},

"contextWindow": 200000,

"maxTokens": 8192

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "minimax-cn/MiniMax-M2.5"

},

"models": {

"minimax-cn/MiniMax-M2.5": {

"alias": "Minimax"

}

},

"compaction": {

"mode": "safeguard"

},

"maxConcurrent": 4,

"subagents": {

"maxConcurrent": 8

}

}

},

"auth": {

"profiles": {

"minimax-cn:default": {

"provider": "minimax-cn",

"mode": "api_key"

}

}

},

"gateway": {

"mode": "local",

"auth": {

"mode": "token",

"token": "your-gateway-token"

}

}

}路径:~/.openclaw/agents/main/agent/auth-profiles.json

{

"version": 1,

"profiles": {

"minimax-cn:default": {

"type": "api_key",

"provider": "minimax-cn",

"key": "sk-your-api-key"

}

},

"usageStats": {

"minimax-cn:default": {

"lastUsed": 0,

"errorCount": 0

}

}

}路径:~/.openclaw/agents/main/agent/models.json

{

"providers": {

"minimax-cn": {

"baseUrl": "http://model.imfan.top/v1",

"apiKey": "sk-your-api-key",

"api": "openai-responses",

"models": [

{

"id": "MiniMax-M2.5",

"name": "MiniMax M2.5",

"reasoning": true,

"input": ["text"],

"cost": {

"input": 0.3,

"output": 1.2,

"cacheRead": 0.03,

"cacheWrite": 0.12

},

"contextWindow": 200000,

"maxTokens": 8192,

"api": "openai-responses"

}

]

}

}

}minimax-cn,模型引用格式为 minimax-cn/MiniMax-M2.5。如需切换模型(如 MiniMax-M2.5-highspeed),需同时修改三个文件中的模型 ID。

常见问题

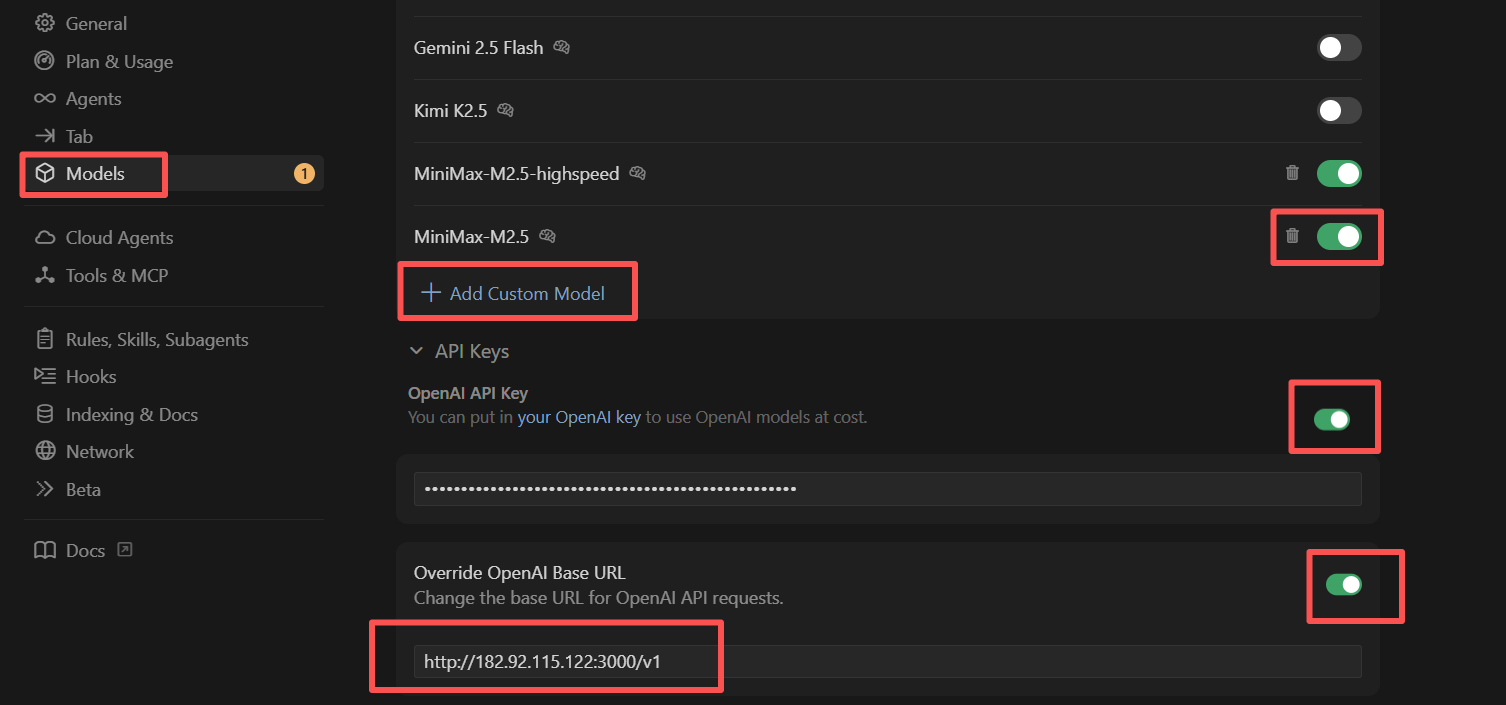

2配置 API Key

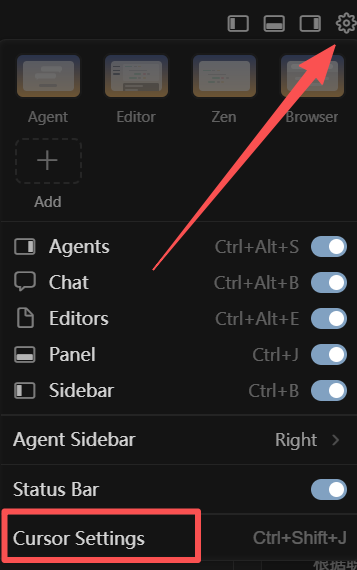

打开设置

点击右上角齿轮图标 → Cursor Settings(或按 Ctrl+Shift+J)

进入 Models 页面

在设置页左侧菜单点击 Models,然后配置 API Key 和 Override URL。

配置 OpenAI API Key

在 Models 页面找到 OpenAI API Key 输入框,填入信息:

您的 API 密钥 (sk-...)http://model.imfan.top/v13添加模型

添加自定义模型

在 Models 页面下方的模型列表区域,点击 + Add model,输入模型名称(如 [{modelName}]),按回车添加。

常用模型名称

| 模型 | 名称 |

|---|---|

| MiniMax-M2.5 | MiniMax-M2.5 |

| MiniMax-M2.5 高速版 | MiniMax-M2.5-highspeed |

| GLM-5.1 | glm-5.1 |

| GLM-4.7 | glm-4.7 |

若旧截图仍标为 glm-5,请改为 glm-5.1。

4使用方式

AI 对话(Chat)

按 Ctrl+L(Mac: Cmd+L)打开 AI 对话面板,选择上面配置好的模型,即可对话。

内联编辑(Inline Edit)

选中代码后按 Ctrl+K(Mac: Cmd+K),输入修改指令,AI 直接在编辑器中修改代码。

Agent 模式

在 Chat 面板中切换到 Agent 模式,AI 可以自主搜索代码、编辑多个文件、运行命令,适合复杂任务。

代码补全(Tab)

编写代码时 AI 会自动给出补全建议,按 Tab 接受。

常见问题

1安装插件

- 打开 VS Code

- 扩展商店搜索

Roo Code - 点击安装

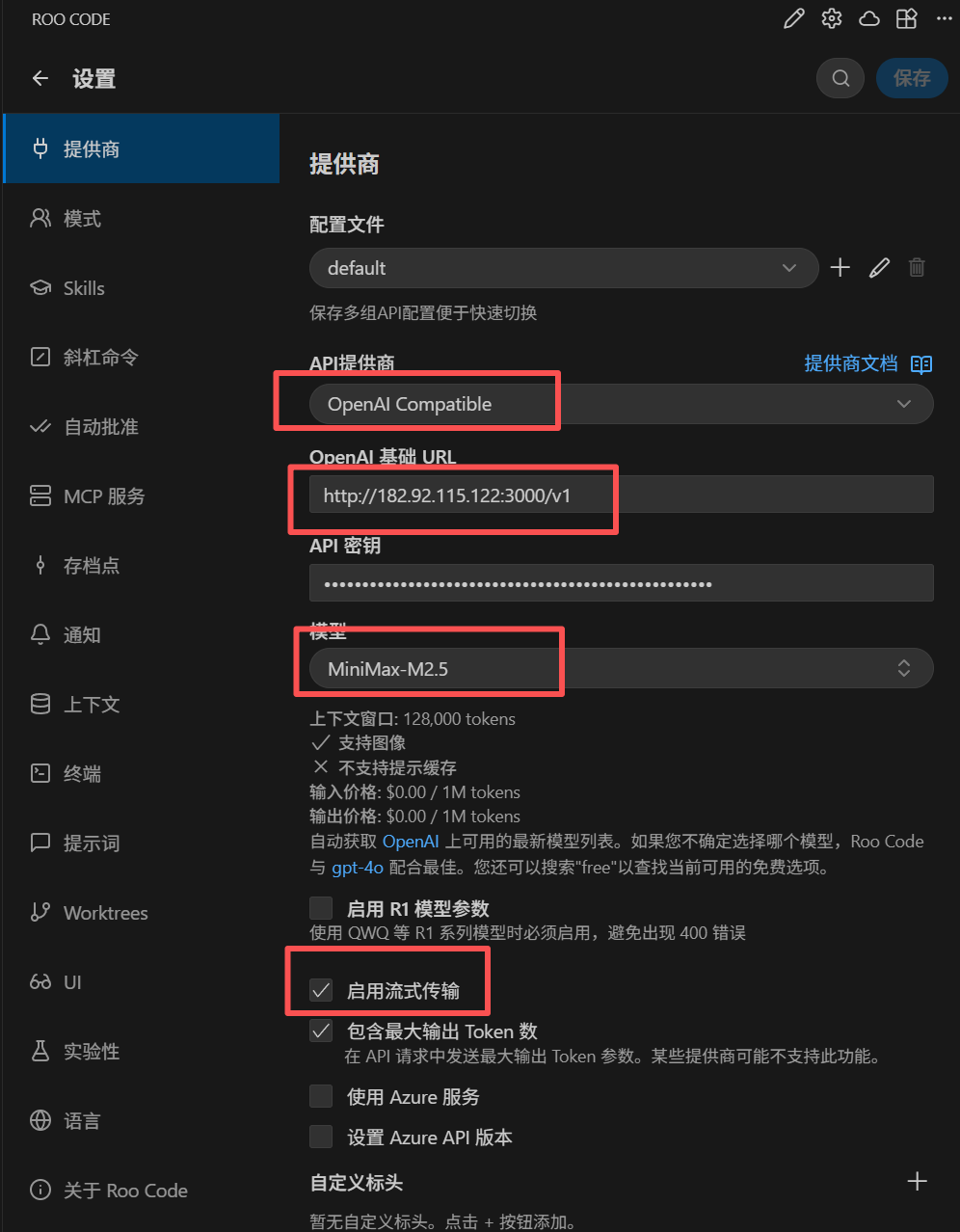

2配置 API

打开 Roo Code 设置

VS Code 侧边栏 → 点击 Roo Code 图标 → 点击顶部 齿轮图标(设置)→ 进入「提供商」页面

填写配置信息

OpenAI Compatiblehttp://model.imfan.top/v1您的 API 密钥 (sk-...)模型名称(需与服务端一致)/v1 结尾!不加会导致 chat content is empty 或 404 错误。

勾选选项并保存

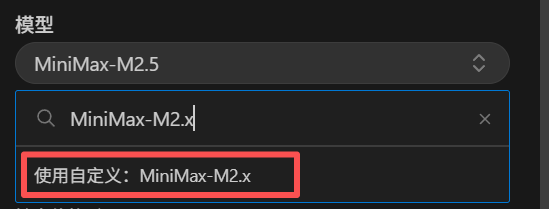

配置示例(红框为关键配置项,请对照填写)

3常用模型名称

模型名区分大小写,必须与服务端配置的名称完全一致。可访问 http://model.imfan.top/v1/models 查看服务端支持的模型列表。

| 模型 | 名称 |

|---|---|

| MiniMax-M2.5 | MiniMax-M2.5 |

| MiniMax-M2.5 高速版 | MiniMax-M2.5-highspeed |

| GLM-5.1 | glm-5.1 |

| GLM-4.7 | glm-4.7 |

旧版教程可能写 glm-5,请手动改为 glm-5.1。

4测试验证

在 Roo Code 中测试

在 Roo Code 对话框输入 hello,收到正常回复即配置成功。

命令行快速验证(可选)

如果 Roo Code 报错,可用命令行测试服务是否正常:

$body = '{"model":"MiniMax-M2.5","messages":[{"role":"user","content":"hello"}],"max_tokens":100}'

$r = Invoke-WebRequest -Uri "http://model.imfan.top/v1/chat/completions" `

-Method POST `

-Headers @{"Authorization"="Bearer 您的API密钥"} `

-ContentType "application/json" `

-Body $body -SkipHttpErrorCheck

Write-Output "Status: $($r.StatusCode)"

Write-Output $r.Contentcurl http://model.imfan.top/v1/chat/completions \

-H "Authorization: Bearer 您的API密钥" \

-H "Content-Type: application/json" \

-d '{"model":"MiniMax-M2.5","messages":[{"role":"user","content":"hello"}],"max_tokens":100}'返回 200 且包含 choices 字段即为正常。若命令行也报错,说明问题出在服务端而非 Roo Code。

常见问题

1安装插件

- 打开 VS Code 或 Cursor

- 扩展商店搜索

Cline - 点击安装,安装后侧边栏出现 Cline 图标

2配置 API

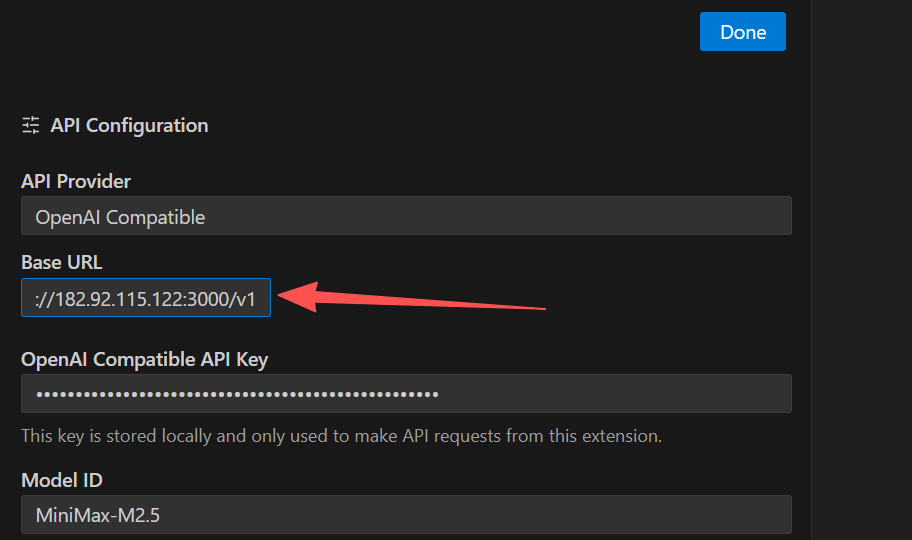

打开 Cline 设置

侧边栏点击 Cline 图标 → 点击顶部 齿轮图标(设置)进入 API Configuration 页面

选择 API Provider → OpenAI Compatible,填写配置

OpenAI Compatiblehttp://model.imfan.top/v1您的 API 密钥 (sk-...)[{modelName}]/v1 结尾!如下图箭头所示,不加 /v1 会导致请求失败。

点击 Done 保存

配置完成后点击右上角 Done 按钮保存,即可开始使用。

3常用模型名称

| 模型 | 名称 |

|---|---|

| MiniMax-M2.5 | MiniMax-M2.5 |

| MiniMax-M2.5 高速版 | MiniMax-M2.5-highspeed |

| GLM-5.1 | glm-5.1 |

| GLM-4.7 | glm-4.7 |

旧版教程可能写 glm-5,请手动改为 glm-5.1。

常见问题

本站支持两种编程助手 MCP,配置方式与变量名完全不同。请先点选下方卡片切换对应教程。

后台需 MiniMax 类型渠道,模型包含 coding-plan-vlm、coding-plan-search。MINIMAX_API_HOST 填本站根地址,不要加 /v1。

1前置准备:安装 uvx

MCP 服务端通过 uvx 运行,需要先安装 uv:

powershell -ExecutionPolicy ByPass -c "irm https://astral.sh/uv/install.ps1 | iex"

curl -LsSf https://astral.sh/uv/install.sh | sh

验证安装:

uvx --version

spawn uvx ENOENT,需要使用 uvx 的绝对路径。运行 where uvx(Windows)或 which uvx(Mac/Linux)获取路径,替换配置中的 uvx。

2提供的工具

| 工具名称 | 功能 | 说明 |

|---|---|---|

web_search | 联网搜索 | 搜索实时网页信息,返回标题、链接、摘要 |

understand_image | 图片理解 | 分析图片内容,支持 JPEG/PNG/WebP(最大 20MB) |

3配置 MCP(选择你的工具)

编辑配置文件 ~/.config/opencode/opencode.jsonc(Windows: C:\Users\用户名\.config\opencode\opencode.jsonc),在 JSON 中添加 mcp 字段:

{

"mcp": {

"MiniMax": {

"type": "local",

"command": ["uvx", "minimax-coding-plan-mcp"],

"environment": {

"MINIMAX_API_KEY": "您的API密钥",

"MINIMAX_API_HOST": "http://model.imfan.top"

},

"enabled": true

}

}

}MINIMAX_API_HOST 不需要加 /v1,直接填基础地址即可。mcp 字段与 provider 字段同级。

保存后重启 OpenCode,输入 /mcp 查看连接状态,显示 MiniMax connected 即配置成功。

打开 Cursor Settings → Tools & Integrations → MCP → Add new global MCP server,在打开的 mcp.json 中填入:

{

"mcpServers": {

"MiniMax": {

"command": "uvx",

"args": ["minimax-coding-plan-mcp"],

"env": {

"MINIMAX_API_KEY": "您的API密钥",

"MINIMAX_API_HOST": "http://model.imfan.top"

}

}

}

}保存后回到 MCP 页面,MiniMax 应显示为绿色(已连接)。如未自动刷新,重启 Cursor。

方式一:一键安装(在终端运行)

claude mcp add MiniMax uvx minimax-coding-plan-mcp -s user -e MINIMAX_API_KEY=您的API密钥 MINIMAX_API_HOST=http://model.imfan.top

方式二:手动编辑 ~/.claude.json

{

"mcpServers": {

"MiniMax": {

"command": "uvx",

"args": ["minimax-coding-plan-mcp"],

"env": {

"MINIMAX_API_KEY": "您的API密钥",

"MINIMAX_API_HOST": "http://model.imfan.top"

}

}

}

}配置后输入 /mcp 验证,能看到 web_search 和 understand_image 即为成功。

4使用方式

联网搜索

直接让 AI 搜索即可,AI 会自动调用 web_search 工具。

图片理解

提供图片路径或 URL,AI 会自动调用 understand_image 工具分析图片。

常见问题(MiniMax MCP)

@z_ai/mcp-server)说明见 智谱官方文档。经本站中转:后台配置智谱 zhipu_4v 渠道;下方 Z_AI_API_KEY 填本站令牌,Z_AI_BASE_URL 填 http://你的域名/v1/(注意末尾 /)。

客户端配置

在 OpenCode 配置中增加 MCP(字段名以你使用的 OpenCode 版本为准),示例:

{

"mcp": {

"zai-mcp-server": {

"type": "local",

"command": ["npx", "-y", "@z_ai/mcp-server@latest"],

"environment": {

"Z_AI_API_KEY": "您的API密钥",

"Z_AI_BASE_URL": "http://model.imfan.top/v1/"

},

"enabled": true

}

}

}在 Cursor 的 mcp.json 中:

{

"mcpServers": {

"zai-mcp-server": {

"command": "npx",

"args": ["-y", "@z_ai/mcp-server@latest"],

"env": {

"Z_AI_API_KEY": "您的API密钥",

"Z_AI_BASE_URL": "http://model.imfan.top/v1/"

}

}

}

}方式一:命令行添加

claude mcp add zai-mcp-server --env Z_AI_API_KEY=您的API密钥 --env Z_AI_BASE_URL=http://model.imfan.top/v1/ -- npx -y "@z_ai/mcp-server@latest"

方式二:手动编辑 项目或用户目录下的 .claude.json

{

"mcpServers": {

"zai-mcp-server": {

"type": "stdio",

"command": "npx",

"args": ["-y", "@z_ai/mcp-server@latest"],

"env": {

"Z_AI_API_KEY": "您的API密钥",

"Z_AI_BASE_URL": "http://model.imfan.top/v1/"

}

}

}

}配置后重启 Claude Code,将图片放在项目目录下,用对话说明文件路径即可测试。

功能概览

14+

预置音色

8

语音模型

MP3

音频下载

POST /v1/audio/speech 接入常见问题

相关链接

秘钥激活Tutorial